25 वर्षीय सुचिर बालाजी की मौत ने पूरी दुनिया को हिला कर रख दिया है, खासकर तब जब यह न्यूयॉर्क टाइम्स की एक विस्फोटक प्रोफ़ाइल के कुछ हफ्तों बाद हुई, जिसमें उन्होंने ओपनएआई में अपने समय और कृत्रिम बुद्धिमत्ता (एआई) के हानिकारक प्रभावों के बारे में विस्तार से बात की थी।

भारतीय-अमेरिकी शोधकर्ता, जो पहले ओपनएआई में काम करते थे, 26 नवंबर को सैन फ्रांसिस्को में अपने अपार्टमेंट में मृत पाए गए, रिपोर्ट्स के अनुसार। जबकि पुलिस ने दावा किया है कि उन्होंने आत्महत्या की, लेकिन इसके समय ने कई सवाल खड़े कर दिए हैं।

बालाजी ने न्यूयॉर्क टाइम्स की एक प्रोफ़ाइल में अपनी पूर्व कंपनी के बारे में बात की और आरोप लगाया कि कंपनी ने चैटजीपीटी चैटबॉट के विकास के दौरान अमेरिकी कॉपीराइट कानूनों का उल्लंघन किया, साथ ही कई अन्य गंभीर सच्चाइयों का भी खुलासा किया।

सुचिर बालाजी ने क्या खुलासा किया?

कॉपीराइट मुद्दे

एनवाईटी के अनुसार, बालाजी ने बताया कि शुरुआत में उन्हें ओपनएआई के साथ कॉपीराइट मुद्दों के बारे में कोई जानकारी नहीं थी और उनका मानना था कि कंपनी “इंटरनेट डेटा का उपयोग करने के लिए स्वतंत्र है, चाहे वह कॉपीराइटेड हो या नहीं।”

2022 में चैटजीपीटी के रिलीज़ के बाद ही उन्हें कंपनी के काम करने के तरीके और उसके उद्देश्यों पर शक हुआ। एनवाईटी के अनुसार, उन्हें लगा कि “ओपनएआई का कॉपीराइटेड डेटा का उपयोग कानून का उल्लंघन कर रहा है और तकनीकें जैसे चैटजीपीटी इंटरनेट को नुकसान पहुंचा रही हैं।”

न्यूयॉर्क टाइम्स के साथ अपने साक्षात्कार में उन्होंने कहा, “यदि आप वही मानते हैं जो मैं मानता हूं, तो आपको कंपनी छोड़नी होगी।”

डेटा ट्रेनिंग

कैलिफोर्निया के रहने वाले 25 वर्षीय बालाजी लगभग चार वर्षों तक ओपनएआई में काम कर चुके थे, उन्होंने 2021 में यूनिवर्सिटी ऑफ कैलिफोर्निया, बर्कले से कंप्यूटर साइंस में स्नातक की डिग्री हासिल की थी।

कंपनी में शामिल होने के एक साल बाद, उन्होंने जीपीटी-4 प्रोजेक्ट पर काम करना शुरू किया, और उनके कार्यों में डिजिटल डेटा के बड़े पैमाने पर संग्रह और उसका विश्लेषण करना शामिल था।

हालांकि, इस दौरान उन्होंने चीजों पर सवाल उठाना शुरू कर दिया क्योंकि जीपीटी-4 प्रोजेक्ट को शुरू में “मौजूदा इंटरनेट सेवाओं के साथ प्रतिस्पर्धा” करने की उम्मीद नहीं थी।

उन्होंने सोचा था कि यह जीपीटी-3 के समान होगा, जो एक चैटबॉट नहीं था बल्कि “एक तकनीक थी जो व्यवसायों और कंप्यूटर कोडर्स को अन्य सॉफ़्टवेयर एप्लिकेशन बनाने की अनुमति देती थी।”

उन्होंने यह भी दावा किया कि न केवल चैटजीपीटी बल्कि अन्य एआई जनरेटिव चैटबॉट भी “उन व्यक्तियों, व्यवसायों और इंटरनेट सेवाओं के व्यावसायिक व्यवहार्यता को नष्ट कर रहे हैं जिन्होंने इन एआई सिस्टम्स को प्रशिक्षित करने के लिए डिजिटल डेटा बनाया।”

Read More: Is It Time To Be Afraid Of AI?

एआई उम्मीद से ज्यादा खतरनाक?

बालाजी को तकनीक में दिलचस्पी तब आई जब उन्होंने डीपमाइंड की तकनीकों, खासकर न्यूरल नेटवर्क, के बारे में जाना। एआई के बारे में बात करते हुए बालाजी ने कहा, “मुझे लगा कि एआई एक ऐसी चीज है जिसका उपयोग असंभव समस्याओं को हल करने के लिए किया जा सकता है, जैसे कि बीमारियों का इलाज करना और उम्र बढ़ने को रोकना,” और उन्होंने जोड़ा, “मुझे लगा कि हम किसी तरह के वैज्ञानिक का आविष्कार कर सकते हैं जो इन्हें हल करने में मदद कर सके।”

बालाजी 2020 में बर्कले के कुछ ग्रेजुएट छात्रों के एक समूह में शामिल हुए, जिन्होंने ओपनएआई के लिए काम करना शुरू किया। जीपीटी-4 के विकास के दौरान, उन्होंने डिजिटल डेटा इकट्ठा करना शुरू किया, जो न्यूयॉर्क टाइम्स के अनुसार “एक न्यूरल नेटवर्क था जिसने इंटरनेट पर लगभग सभी अंग्रेजी भाषा के पाठ का महीनों तक विश्लेषण किया।”

बालाजी और उनके सहकर्मियों को वास्तव में इस बात का अंदाजा नहीं था कि इसे सार्वजनिक रूप से जारी किया जाएगा और उन्होंने इसे एक शोध परियोजना के रूप में माना क्योंकि “एक शोध परियोजना के साथ, सामान्य तौर पर, आप किसी भी डेटा पर प्रशिक्षण दे सकते हैं… यही उस समय की मानसिकता थी।”

चैटजीपीटी “फेयर यूज़” सिद्धांत के 4 मापदंडों को पूरा नहीं करता

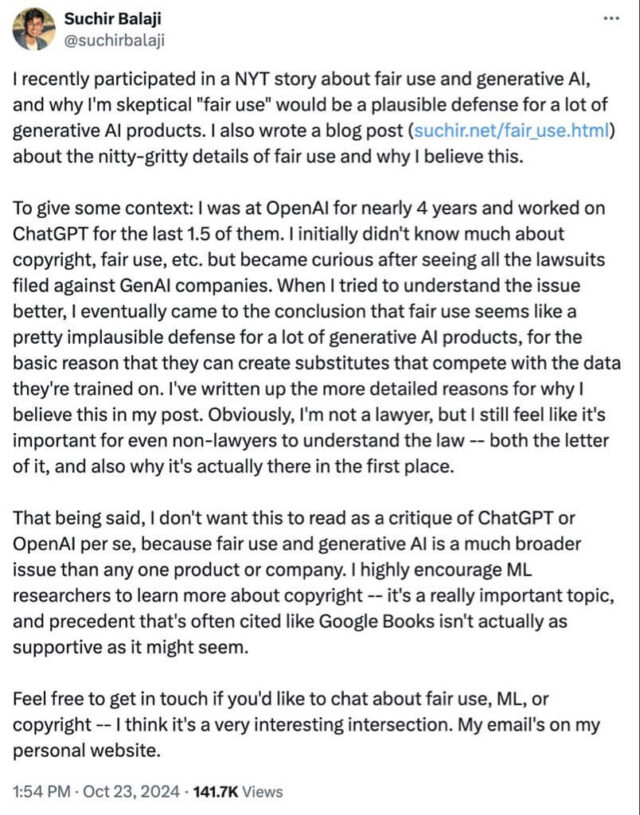

23 अक्टूबर को अपने ब्लॉग (https://suchir.net/fair_use.html) पर बालाजी ने “व्हेन डस गेनेरेटिव एआई क्वालीफाई फॉर फेयर यूज़?” शीर्षक से एआई ट्रेनिंग और फेयर यूज़ के बीच पतली रेखा पर चर्चा की।

न्यूयॉर्क टाइम्स (एनवाईटी) से बात करते हुए बालाजी ने कहा, “आउटपुट इनपुट की सटीक कॉपी नहीं होते, लेकिन वे मौलिक रूप से भी नए नहीं हैं।”

उन्होंने चैटजीपीटी के उस ट्रेनिंग डेटा पर लिखा जिसका उपयोग इसके विशाल सिस्टम को बनाने के लिए किया गया और इनमें से उन्होंने कहा, “मॉडल डेवलपर्स जैसे ओपनएआई और गूगल ने भी स्टैक ओवरफ्लो, रेडिट, द एसोसिएटेड प्रेस, न्यूज़ कॉर्प आदि के साथ अपने मॉडलों को कॉपीराइटेड डेटा पर प्रशिक्षित करने के लिए कई डेटा लाइसेंसिंग समझौतों पर हस्ताक्षर किए हैं।”

बालाजी ने अपने ब्लॉग में लिखा, “यदि इन डेटा पर प्रशिक्षण ‘फेयर यूज़’ था, तो यह समझौते क्यों किए गए, यह स्पष्ट नहीं है। लेकिन यह मुद्दा अलग है। डेटा लाइसेंसिंग बाजार के अस्तित्व को देखते हुए, बिना समान लाइसेंसिंग समझौते के कॉपीराइटेड डेटा पर प्रशिक्षण भी बाजार को नुकसान का एक प्रकार है, क्योंकि यह कॉपीराइट धारक को राजस्व के एक स्रोत से वंचित करता है।”

उन्होंने अपने पोस्ट का निष्कर्ष लिखते हुए कहा, “चार में से कोई भी कारक चैटजीपीटी के ट्रेनिंग डेटा के ‘फेयर यूज़’ में होने का पक्ष नहीं लेता। यह कहा जा सकता है कि ये तर्क केवल चैटजीपीटी तक सीमित नहीं हैं, और ऐसे ही तर्क कई जनरेटिव एआई उत्पादों के लिए विभिन्न क्षेत्रों में भी किए जा सकते हैं।”

बालाजी की 24 अक्टूबर 2024 की आखिरी पोस्ट एक्स/ट्विटर पर भी नेवाइटी की उनकी प्रोफ़ाइल और जनरेटिव एआई के लिए ‘फेयर यूज़’ तर्क की कमजोरी पर केंद्रित थी। उन्होंने यह भी कहा कि इस क्षेत्र में और अधिक स्पष्टता की आवश्यकता है।

उन्होंने लिखा, “जब मैंने इस मुद्दे को बेहतर तरीके से समझने की कोशिश की, तो अंततः मैं इस नतीजे पर पहुंचा कि ‘फेयर यूज़’ जनरेटिव एआई उत्पादों के लिए एक बहुत ही अविश्वसनीय बचाव लगता है, क्योंकि ये ऐसे विकल्प तैयार कर सकते हैं जो उस डेटा के साथ प्रतिस्पर्धा करते हैं जिस पर इन्हें प्रशिक्षित किया गया है।

मैंने अपने पोस्ट में इसके बारे में अधिक विस्तृत कारण लिखे हैं। जाहिर है, मैं वकील नहीं हूं, लेकिन मुझे फिर भी ऐसा लगता है कि गैर-वकीलों के लिए भी कानून को समझना महत्वपूर्ण है — न केवल कानून के शब्दों को, बल्कि यह भी कि यह वास्तव में पहली बार में क्यों बनाया गया था।”

Image Credits: Google Images

Sources: The Indian Express, The Hindu, The New York Times

Originally written in English by: Chirali Sharma

Translated in Hindi by Pragya Damani

This post is tagged under: Suchir Balaji, Suchir Balaji death, Suchir Balaji ai, Suchir Balaji open ai, Suchir Balaji openai truths, openai, openai truths, ai, artificial intelligence,

Disclaimer: We do not hold any right, or copyright over any of the images used, these have been taken from Google. In case of credits or removal, the owner may kindly mail us.

Other Recommendations:

Google’s AI Gemini Abuses Student; Pesters Him To ‘Please Die’